A inteligência artificial no desenvolvimento deixou de ser tendência para se tornar realidade no dia a dia das equipes de TI. Ferramentas que geram código, sugerem testes, documentam funções e até corrigem bugs já fazem parte da rotina de muitos desenvolvedores.

Mas existe um ponto que quase ninguém comenta com profundidade: os riscos da IA no desenvolvimento de software. Enquanto o discurso público destaca produtividade e inovação, há uma camada mais silenciosa que envolve segurança, qualidade, dependência tecnológica e impacto na arquitetura dos sistemas.

Se você trabalha com tecnologia, liderança técnica ou gestão de projetos, este é um assunto que merece atenção — e não apenas entusiasmo.

Riscos da IA no desenvolvimento de software e a falsa sensação de produtividade

Os riscos da IA no desenvolvimento de software começam de forma sutil: com a ilusão de que tudo ficou mais rápido e, portanto, melhor.

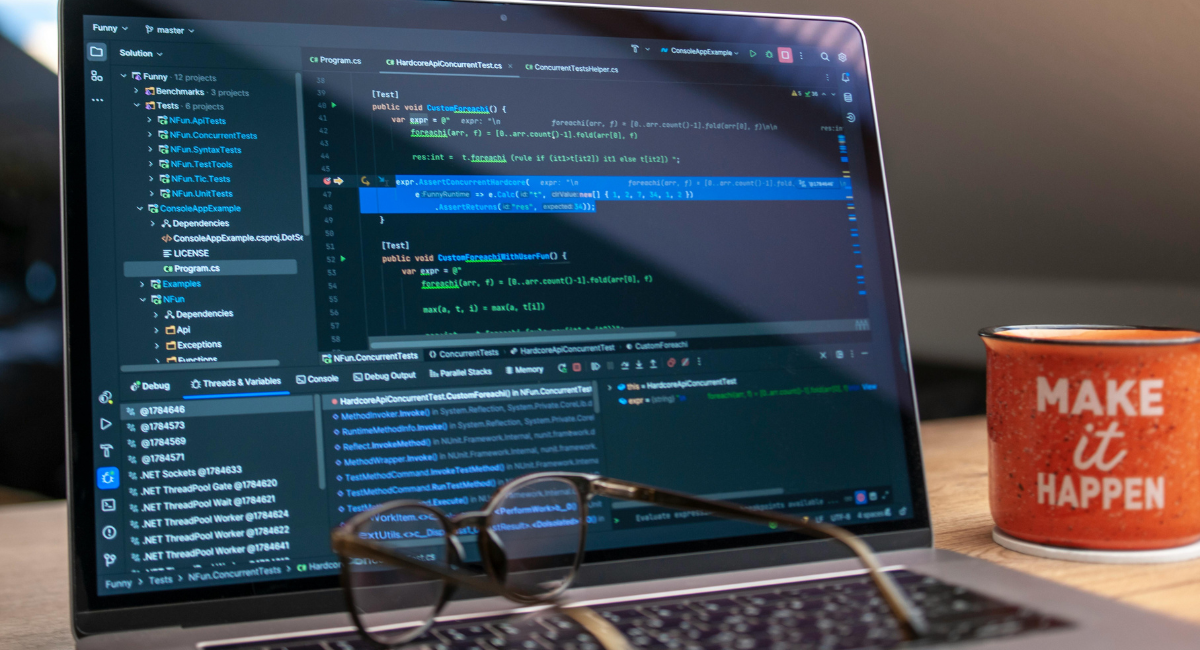

De fato, a inteligência artificial no desenvolvimento acelera tarefas repetitivas. Ela sugere trechos de código, cria funções completas e automatiza partes do fluxo de trabalho. No entanto, velocidade não é sinônimo de qualidade.

Primeiramente, o código gerado pode parecer funcional, mas muitas vezes carece de contexto arquitetural. Ele resolve o problema imediato, mas não considera escalabilidade, padrões internos da empresa ou requisitos específicos de negócio.

Além disso, há o risco de:

- Geração de código com vulnerabilidades ocultas

- Uso de bibliotecas desatualizadas ou inseguras

- Falta de aderência a boas práticas internas

- Duplicação de lógica já existente no projeto

Consequentemente, o time pode ganhar horas no curto prazo e perder semanas no futuro corrigindo falhas estruturais.

Outro ponto delicado é a perda de pensamento crítico. Quando o desenvolvedor passa a confiar excessivamente na sugestão automática, a análise profunda do problema pode diminuir. E, em tecnologia, a superficialidade costuma custar caro.

Inteligência artificial no desenvolvimento e os desafios de segurança

Quando falamos em inteligência artificial no desenvolvimento, segurança precisa estar no centro da conversa.

Ferramentas de IA são treinadas com grandes volumes de código público. Isso significa que, eventualmente, podem reproduzir padrões inseguros, trechos com vulnerabilidades conhecidas ou práticas que já não são recomendadas.

Entre os principais riscos da IA no desenvolvimento de software relacionados à segurança, destacam-se:

- Injeções de SQL mal tratadas

- Falhas em autenticação e autorização

- Ausência de validação adequada de entrada de dados

- Exposição acidental de dados sensíveis

Além disso, há uma questão ainda mais sensível: propriedade intelectual. Dependendo da ferramenta utilizada, pode haver dúvidas sobre a origem do código sugerido. Isso levanta questionamentos jurídicos e contratuais, principalmente em projetos corporativos.

Portanto, embora a inteligência artificial no desenvolvimento ofereça suporte valioso, ela não substitui auditorias de código, revisões humanas e políticas rígidas de segurança da informação.

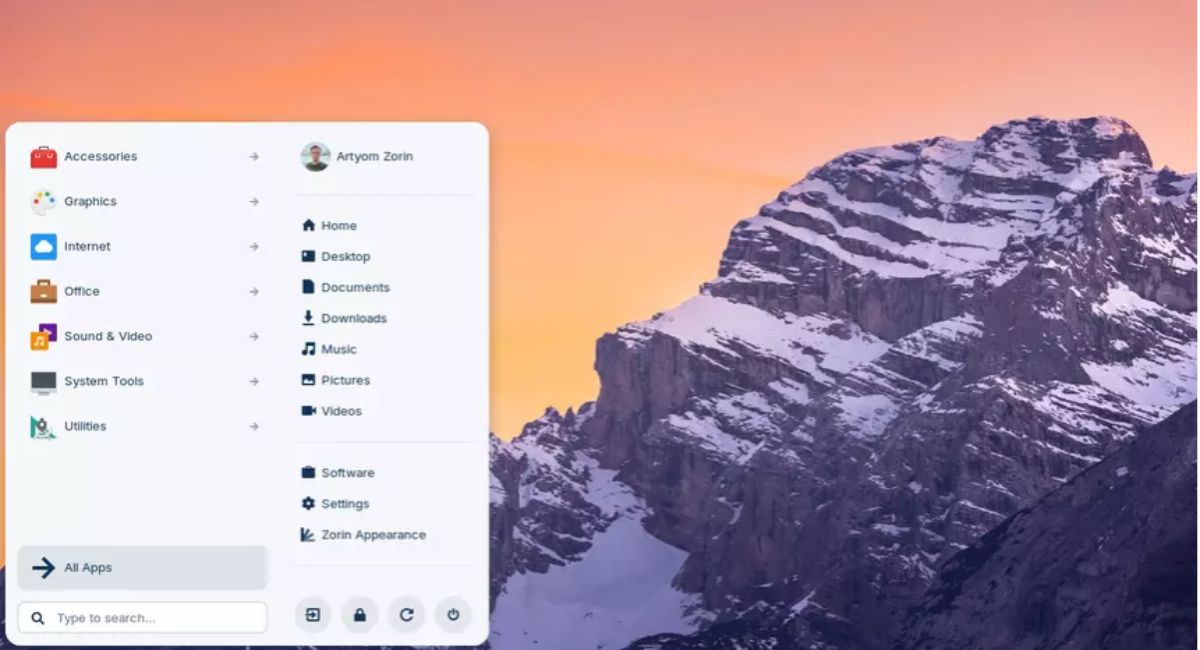

Riscos da IA no desenvolvimento de software e dependência tecnológica

Outro aspecto pouco discutido sobre os riscos da IA no desenvolvimento de software é a dependência excessiva de ferramentas automatizadas.

Com o tempo, equipes podem se tornar altamente dependentes dessas soluções. O problema surge quando:

- A ferramenta muda o modelo de precificação

- O serviço sofre instabilidade

- Há mudanças nas políticas de uso

- O acesso é restringido por questões regulatórias

Nesse cenário, a produtividade construída sobre a IA pode simplesmente desaparecer da noite para o dia.

Além disso, há um impacto direto na formação técnica. Desenvolvedores iniciantes que utilizam intensivamente inteligência artificial no desenvolvimento podem deixar de consolidar fundamentos essenciais, como lógica, estrutura de dados e design de software.

Sem base sólida, o profissional se torna um “operador de ferramenta” — e não um engenheiro capaz de resolver problemas complexos.

A longo prazo, isso pode afetar a maturidade técnica das equipes e comprometer a capacidade de inovação real.

Inteligência artificial no desenvolvimento e impacto na arquitetura de software

Quando falamos de sistemas robustos, arquitetura é tudo. E aqui mora um dos maiores riscos da IA no desenvolvimento de software.

Ferramentas de IA tendem a gerar soluções pontuais. Elas respondem a prompts específicos. No entanto, arquitetura exige visão sistêmica.

Por exemplo:

- Como esse novo módulo conversa com os demais?

- Há impacto na performance?

- O design respeita princípios como SOLID?

- A solução é sustentável a longo prazo?

A inteligência artificial no desenvolvimento raramente considera o ecossistema completo da aplicação. Ela entrega blocos funcionais, mas não garante coesão estrutural.

Assim, sem supervisão experiente, o código pode se tornar fragmentado, inconsistente e difícil de manter.

Em projetos pequenos, o impacto pode parecer mínimo. Porém, em sistemas corporativos, microsserviços ou aplicações de missão crítica, isso pode comprometer toda a estabilidade.

Riscos da IA no desenvolvimento de software na cultura das equipes

Os riscos da IA no desenvolvimento de software também atingem a cultura organizacional.

Primeiramente, pode surgir uma falsa expectativa de que equipes menores darão conta de demandas maiores apenas porque usam inteligência artificial no desenvolvimento. Isso aumenta pressão, reduz margens de erro e pode levar a decisões apressadas.

Além disso, há um impacto psicológico importante. Desenvolvedores podem sentir insegurança sobre sua relevância no mercado. Essa sensação, quando mal gerida, afeta produtividade e colaboração.

Por outro lado, quando bem estruturada, a IA deve atuar como ferramenta de apoio — nunca como substituta de competência humana.

Empresas que adotam inteligência artificial no desenvolvimento com maturidade costumam:

- Manter revisões humanas obrigatórias

- Investir em capacitação contínua

- Criar diretrizes claras de uso

- Monitorar métricas de qualidade e segurança

Ou seja, o problema não está na tecnologia em si, mas na forma como ela é implementada.

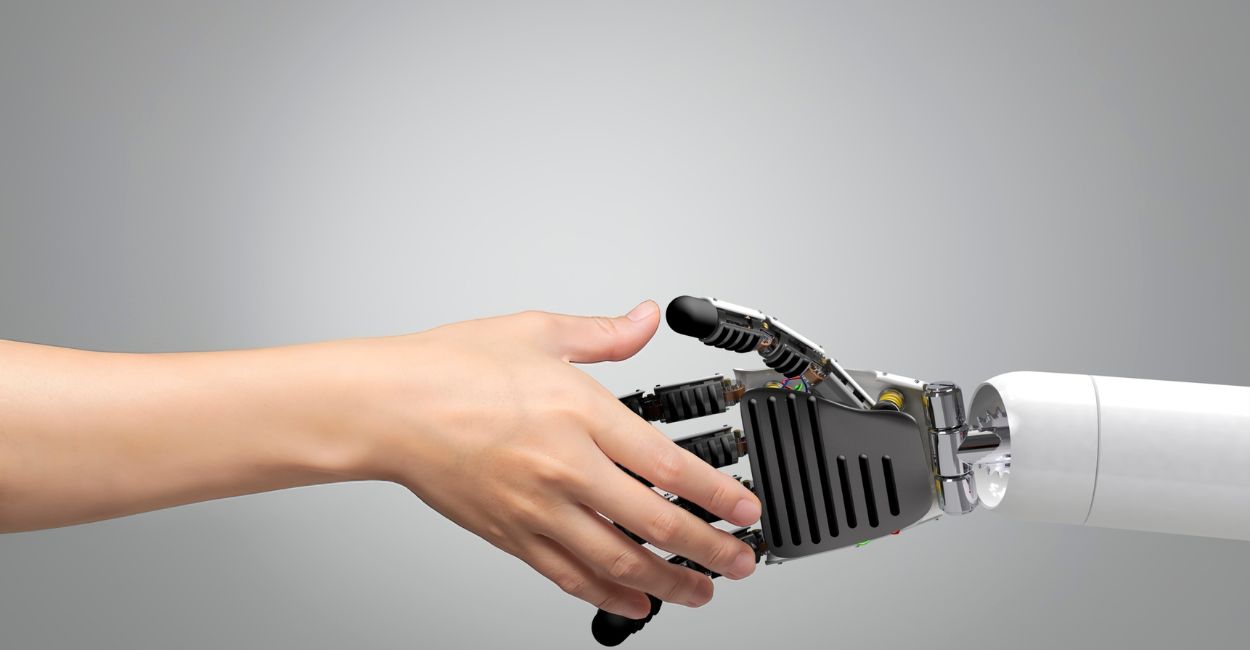

Inteligência artificial no desenvolvimento: como usar com estratégia e reduzir riscos

Apesar dos riscos da IA no desenvolvimento de software, ignorar a tecnologia também não é uma solução viável. O mercado já se movimenta rapidamente nessa direção.

Então, qual é o caminho equilibrado?

Primeiramente, é essencial enxergar a inteligência artificial no desenvolvimento como ferramenta complementar. Ela pode acelerar tarefas, sugerir melhorias e automatizar etapas, mas a responsabilidade final continua sendo humana.

Em segundo lugar, estabeleça políticas internas claras. Defina quando a IA pode ser usada, como o código deve ser revisado e quais padrões precisam ser respeitados.

Além disso:

- Sempre revise manualmente o código gerado

- Realize testes automatizados e testes de segurança

- Avalie impacto arquitetural antes de integrar soluções

- Documente decisões técnicas

Por fim, incentive pensamento crítico. Desenvolvedores devem questionar sugestões da IA, entender o porquê das soluções e adaptar o código ao contexto real do projeto.

A verdade pouco comentada é simples: a inteligência artificial no desenvolvimento é poderosa, mas não é mágica. Ela amplifica tanto boas práticas quanto erros.

E é justamente aí que mora o risco — e a oportunidade.

Conclusão

Integrar inteligência artificial no desenvolvimento é uma decisão estratégica que pode transformar a produtividade das equipes. No entanto, os riscos da IA no desenvolvimento de software não podem ser ignorados.

Segurança, dependência tecnológica, impacto arquitetural e cultura organizacional são fatores que precisam estar no radar de qualquer profissional de TI.

A tecnologia veio para ficar. Porém, maturidade, senso crítico e governança continuam sendo diferenciais humanos insubstituíveis.

Se usada com responsabilidade, a IA pode ser uma aliada poderosa. Se adotada sem estratégia, pode se tornar um problema silencioso — daqueles que só aparecem quando já é tarde demais.