Você já parou para pensar quem decide por você quando um app te sugere um conteúdo, um banco te nega crédito ou um currículo é descartado antes mesmo de uma entrevista? Em muitos desses casos, quem decide não é uma pessoa, mas um sistema. E o mais curioso (e preocupante): nem sempre sabemos como ele decide. É aí que entra o conceito de Black box — a caixa preta da inteligência artificial.

Esse termo vem sendo cada vez mais discutido por especialistas e usuários, principalmente porque estamos delegando decisões importantes a algoritmos que, muitas vezes, não conseguimos compreender. A seguir, vamos desvendar o que está por trás dessa expressão, entender os riscos, comparar abordagens e refletir como isso impacta diretamente a nossa vida.

O que é a Black box na inteligência artificial?

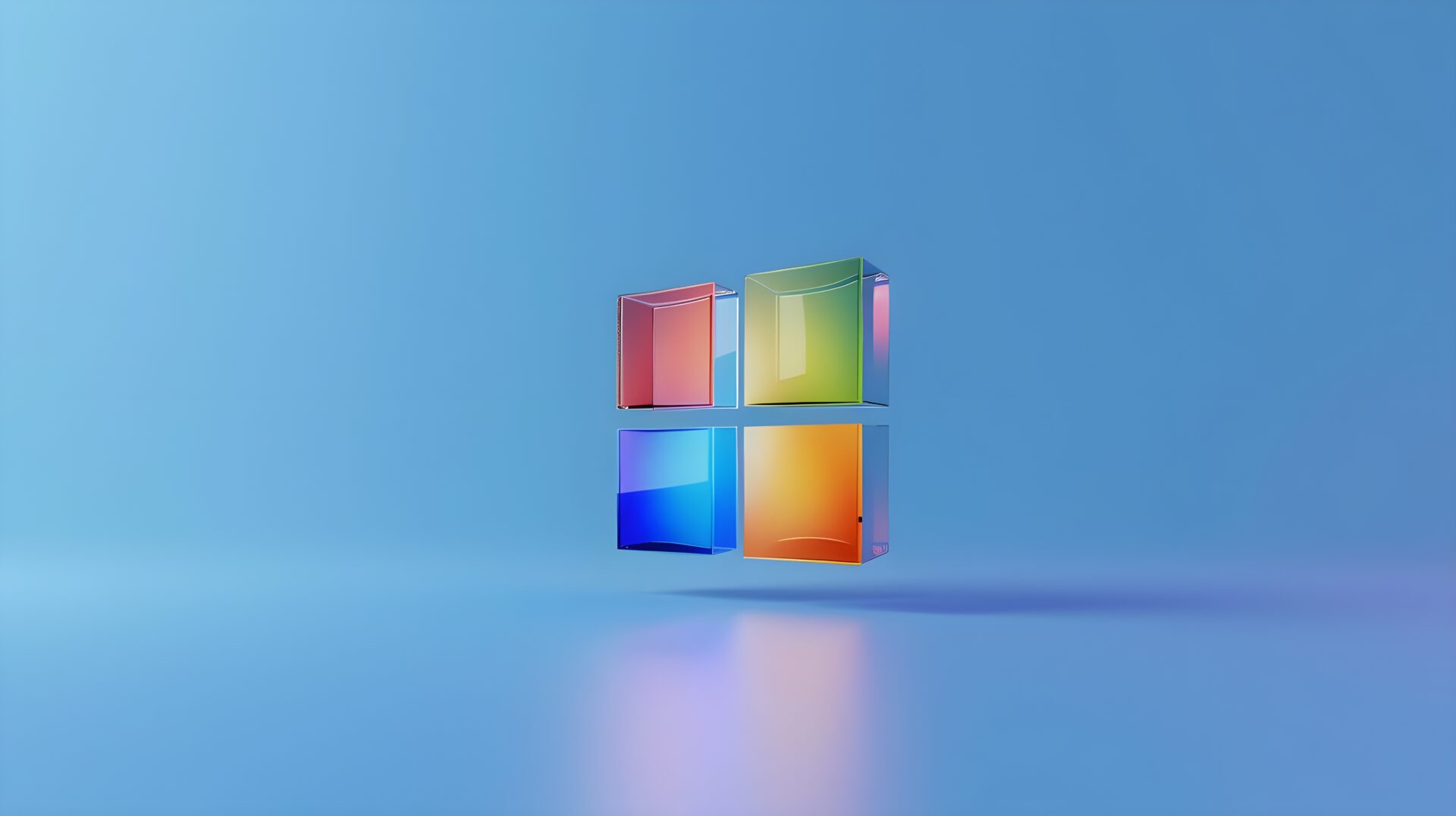

A expressão Black box se refere a sistemas de IA cujos processos internos são opacos. Ou seja, sabemos o que entra e o que sai, mas não conseguimos entender exatamente como o resultado foi alcançado. Imagine uma máquina que recebe informações e entrega uma decisão, mas sem qualquer transparência sobre o caminho entre essas duas pontas.

Esse tipo de funcionamento é comum em modelos complexos de aprendizado de máquina, como redes neurais profundas. Eles são extremamente eficazes para tarefas como reconhecimento de imagem, recomendação de conteúdo e diagnósticos médicos. Porém, essa eficácia vem com um custo: a falta de explicação clara.

A ausência de transparência levanta questões importantes sobre responsabilidade, confiança e até justiça. Afinal, como confiar em uma decisão automatizada se nem mesmo os desenvolvedores conseguem explicar por que o sistema agiu daquela forma?

Black box vs. modelos explicáveis: uma comparação prática

Para entender melhor o dilema, vale observar uma tabela comparativa entre sistemas “caixa preta” e modelos explicáveis (também chamados de “white box”).

| Característica | Black Box | Modelos Explicáveis (White Box) |

| Transparência | Baixa | Alta |

| Precisão | Alta em tarefas complexas | Média a alta |

| Facilidade de interpretação | Difícil ou impossível | Fácil |

| Aplicações comuns | Redes neurais, deep learning | Regressão linear, árvores de decisão |

| Uso em decisões sensíveis | Controverso | Recomendado |

A escolha entre um ou outro depende do contexto. Em situações em que precisão extrema é mais importante que a explicabilidade (como prever padrões climáticos), o modelo caixa preta pode ser aceito. Mas em decisões que impactam vidas, como sentenças judiciais ou diagnósticos médicos, a transparência não deveria ser opcional.

Riscos e dilemas éticos por trás da Black box

Quando falamos de ética na inteligência artificial, a Black box é um dos principais obstáculos. A dificuldade em compreender as decisões automatizadas pode levar à discriminação algorítmica, violação de direitos e falta de prestação de contas.

Um exemplo prático: imagine um sistema de recrutamento que rejeita automaticamente candidatos com base em padrões históricos. Se esses padrões forem enviesados (como favorecimento de homens brancos), o sistema vai apenas replicar — ou até amplificar — esse preconceito. E o pior: muitas vezes, sem que ninguém perceba.

Esse tipo de problema já foi identificado em algoritmos usados por grandes empresas e até no sistema de justiça criminal dos EUA. E por isso, cresce o movimento por auditorias algorítmicas e leis que garantam mais transparência.

Como a Black box afeta a sua vida sem você perceber

Mesmo sem saber, você já foi impactado por decisões de uma Black box. Algumas situações comuns incluem:

- Plataformas que priorizam conteúdos com base em interações passadas

- Aplicativos de crédito que avaliam risco com base em dados do celular

- Ferramentas de seleção de currículos que filtram candidatos automaticamente

- Recomendadores de filmes, músicas e produtos personalizados

O problema não é a automação em si, mas a falta de clareza sobre os critérios usados. Quando não sabemos como a IA está decidindo, não temos como contestar nem corrigir eventuais erros — o que pode ser perigoso em escala social.

Caminhos para mais transparência: é possível abrir a caixa preta?

Sim, há esforços sendo feitos para tornar os sistemas de IA mais compreensíveis. Uma dessas abordagens é o desenvolvimento de técnicas chamadas XAI (Explainable Artificial Intelligence), que buscam explicar de forma simples os motivos por trás de uma decisão algorítmica.

Além disso, surgem leis e regulamentações, como a IA Act da União Europeia, que exigem prestação de contas em modelos utilizados para decisões de alto impacto. Empresas também estão sendo pressionadas por consumidores e órgãos reguladores para serem mais claras sobre como seus algoritmos funcionam.

Entre as principais práticas recomendadas estão:

- Uso de modelos híbridos (mistura entre black box e white box)

- Documentação das decisões algorítmicas

- Simulações e testes de viés nos sistemas

- Inclusão de profissionais multidisciplinares no desenvolvimento

Inteligência artificial confiável: um futuro possível?

Apesar dos desafios, caminhar rumo a uma IA mais transparente e confiável não é utopia. Cada vez mais, especialistas defendem que modelos altamente precisos devem vir acompanhados de explicações claras, principalmente em contextos sensíveis.

A criação de mecanismos que tornem os algoritmos auditáveis e acessíveis não é apenas uma questão técnica, mas social e política. Se a IA está moldando o futuro, é justo que todos possam entender como ela funciona — e não apenas um seleto grupo de desenvolvedores.

Para isso, é fundamental:

- Incentivar o debate público sobre o uso ético da IA

- Desenvolver competências digitais na sociedade

- Exigir leis que protejam os cidadãos contra decisões automatizadas sem explicação

Conclusão: não aceite respostas que você não pode questionar

A ideia de que “se funciona, não importa como” não deve ser aplicada quando falamos de inteligência artificial. A caixa preta precisa ser aberta, questionada e, sempre que possível, transformada em algo transparente e compreensível.Só assim será possível garantir que a tecnologia sirva aos interesses humanos — e não o contrário. Entender o conceito de Black box é o primeiro passo para exigir mais clareza e justiça nos sistemas que moldam nossas vidas. E aí, você está pronto para questionar a próxima sugestão do algoritmo?